Algoritmo de Baum-Welch

Introducción

Uno de los problemas relacionados con los Modelos Ocultos de Márkov (MOM) es el de encontrar un modelo que maximice la probabilidad de una secuencia de observaciones , es decir, determinar el modelo que mejor explica tal secuencia. El problema es que no es posible encontrar tal modelo analíticamente y por ello es necesario un algoritmo iterativo como el de Baum y Welch, que permite estimar los parámetros de un modelo que hacen máxima la probabilidad de una secuencia de observables.

El algoritmo de Baum y Welch

Dada una secuencia de observaciones , el algoritmo de Baum y Welch permite estimar los parámetros de un Modelo oculto de Márkov (MOM) que maximizan la probabilidad de dicha secuencia, es decir, .

Valores esperados

Antes de describir el proceso de estimación, necesitamos conocer:

- el número esperado de transiciones desde el estado en y

- el número esperado de transiciones desde el estado al estado en

Para ello definimos previamente como la probabilidad de estar en el estado en el instante y en el estado en el instante , dado una observación y el modelo .

donde los valores y se pueden calcular eficientemente con el algoritmo de avance-retroceso.

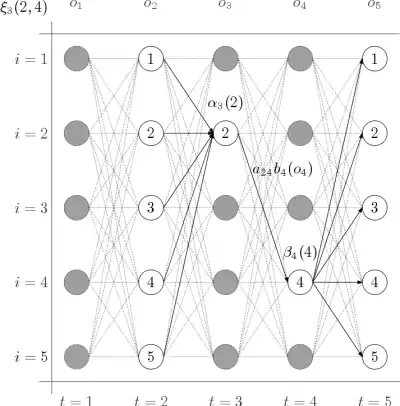

La figura muestra un esquema parcial de los elementos necesarios para el cálculo de .

Definimos también como la probabilidad de estar en el estado en el instante ,

Sumando cada en cada instante de tiempo, obtenemos:

- el número esperado de transiciones desde el estado en la observación

y haciendo lo mismo con cada , obtenemos:

- el número esperado de transiciones desde el estado al estado en la observación

Reestimación

El funcionamiento del procedimiento iterativo es básicamente el siguiente:

- Se parte de un modelo inicial que se puede seleccionar aleatoriamente.

- Se realiza el cálculo de las transiciones y símbolos de emisión que son más probables según el modelo inicial escogido.

- Se construye un nuevo modelo en el que se incrementa la probabilidad de las transiciones y símbolos determinados en el paso anterior. Para la secuencia de observables en cuestión, el modelo tendrá ahora una probabilidad mayor que el modelo anterior.

Este proceso de entrenamiento se repite varias veces hasta que no exista mejora entre un modelo y el siguiente revisado.

Probabilidad de estar en el estado en el instante de tiempo :

Reestimación de las probabilidades de transición. El numerador representa el número esperado de transiciones de a , y el denominador representa el número esperado de transiciones desde :

,

Reestimación de las probabilidades de emisión. El numerador representa el número esperado de veces que se pasa por el estado y se observa , y el denominador representa el número esperado de veces que se pasa por el estado :

,

Otras preguntas fundamentales

Otros dos problemas que es importante saber resolver para utilizar los MOM son:

- ¿Cuál es la secuencia óptima de estados, dada una secuencia de observaciones ? (algoritmo de Viterbi)

- ¿Cuál es la probabilidad de una secuencia de observaciones dado un modelo ? Es decir, ¿cómo podemos calcular de forma eficiente ? (cálculo hacia adelante y hacia atrás).