Algoritmo símplex

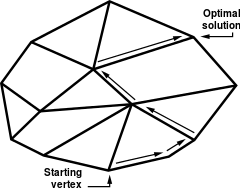

En optimización matemática, el término algoritmo símplex habitualmente se refiere a un conjunto de métodos muy usados para resolver problemas de programación lineal, en los cuales de alguna manera se busca el máximo de una función lineal sobre un conjunto de variables que satisfaga un conjunto de inecuaciones lineales. El algoritmo símplex primal fue desarrollado por el matemático estadounidense George Dantzig en 1947, y procede examinando vértices adyacentes del poliedro de soluciones. Un algoritmo símplex es de alguna manera un algoritmo de pivote.

Un método llamado de manera similar, pero no relacionado al anterior, es el método de Nelder-Mead (1965) o método de descenso (o ascenso) símplex; un método numérico que busca un mínimo (o máximo) local de una función cualquiera examinando en cada paso los vértices de un símplex.

El algoritmo del método símplex fue elegido como uno de los 10 algoritmos más importantes del siglo XX.[1]

Entrada del problema

Consideremos un problema de programación lineal,

El algoritmo símplex requiere que la matriz del problema esté en su forma aumentada. El problema puede ser descrito como sigue:

- Maximizar en:

donde x son las variables desde la forma estándar, xs son las variables de holgura introducidas en el proceso de aumentación, c contiene los coeficientes de optimización, describe el sistema de ecuaciones contraídas, y z es la variable a ser maximizada.

El sistema está típicamente no determinado, ya que el número de variables excede el número de ecuaciones. La diferencia entre el número de variables y el número de ecuaciones nos da los grados de libertad asociados al problema. Cualquier solución, óptima o no, incluirá un número de variables de valor arbitrario. El algoritmo símplex usa cero como valor arbitrario, y el número de variables con valor cero es igual a los grados de libertad.

Las variables con valores diferentes de cero serán llamadas "variables básicas", las demás "variables no básicas".

Esta forma simplifica el encontrar la solución factible básica inicial, dado que todas las variables de la forma estándar pueden ser elegidas para ser no básicas (cero), mientras que todas las nuevas variables introducidas en la forma aumentada, serán básicas (diferentes de cero), dado que su valor puede ser calculado trivialmente ( para ellas, dado que la matriz problema aumentada en diagonal es su lado derecho)

En cada una de las desigualdades que se plantean en el modelo matemático de programación lineal, se plantean desigualdades de <, >, ≤, ≥ o =; estas desigualdades se convierten en igualdades completando con variables de holgura si se trata de menor o igual que, o menor que; en el caso de que sea mayor o igual que o mayor que, se completa con variables de excedente, estas con signo negativo ya que como su nombre lo indica, es una cantidad que está de excedente y hay que quitar para convertirla en igualdad; en caso se maneje el =, se manejan las variables artificiales.

Conceptos básicos

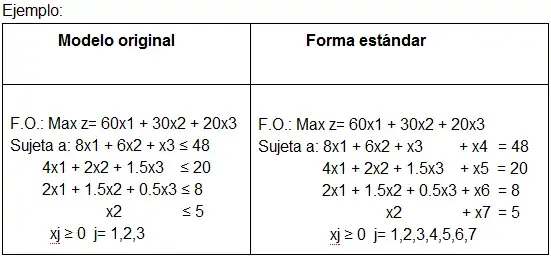

Forma estándar

- Es la igualación de las restricciones del modelo planteado, así como el aumento de variables de holgura, o bien la resta de variables de exceso.

Forma canónica

- En el método símplex es de bastante utilidad la forma canónica, especialmente para explorar la relación de dualidad, donde un problema de programación lineal se encuentra en la forma canónica si se cumplen las siguientes condiciones:

- Para el caso de la forma canónica de maximización:

- La función objetivo debe ser de maximización

- Las variables de decisión no negativas.

- Las restricciones son del tipo .

- Para el caso de la forma canónica de la dieta:

- La función objetivo es minimizada.

- Las restricciones son de tipo .

- Las variables de decisión son no negativas.

- Ejemplo:

- Forma Canónica de Maximización

- Forma Canónica de la dieta

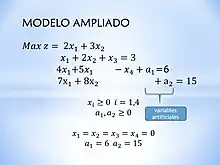

Modelo ampliado

Cuando se introduce en cada restricción una variable artificial que no contenga una variable de holgura.

Variables de entrada

Estas suelen encontrarse en un criterio que se conoce como “Condición de optimalidad”, en un modelo, ya sea de maximización o minimización, y se refiere a la variable no básica en el renglón “z” con el coeficiente más negativo, si se trata de una maximización, o el coeficiente más positivo, si se trata de una minimización, la cual, en la tabla de solución anterior, a excepción de la primera tabla, esta variable era una variable básica.

Variables de salida

Esta variable es un punto extremo que se encuentra en un criterio conocido como “condición de factibilidad”, en un modelo, ya sea de optimización o minimización, y se refiere a la variable básica asociada con la mínima razón no negativa con el coeficiente más negativo, si se trata de una maximización, o el coeficiente más positivo, si se trata de una minimización, la cual, en la tabla de solución siguiente, pasará a ser variable no básica.

| Variables básicas | Variables no básicas | Variable de entrada | Variable de salida | |

|---|---|---|---|---|

| A | X3, X4, X5, X6 | X1, X2 | X1 | X2 |

| B | X3, X4, X5, X1 | X6, X2 | X2 | X3 |

| C | X2, X4, X5, X1 | X6, X3 | X6 | X4 |

| D | X2, X6, X5, X1 | X4, X3 | X3 | X1 |

| E | X2, X6, X5, X3 | X4, X1 | X4 | X2 |

Variable degenerada

Una variable degenerada es una variable básica que vale cero. Gráficamente esto puede ocurrir cuando más de dos rectas tocan una sola intersección en el mismo punto.

Base

Conjunto de variables básicas. En el ejemplo anterior, la base es {X3, X4, X5, X6}

Variable no restringida

Variable artificial

- Se usa una variable artificial cuando las restricciones son = y ≥ y sucede cuando el origen no se encuentra dentro de la región factible, tratando de llevar el modelo a otra dimensión en la cual el origen si exista en la región.

Es aquella que puede tomar toda clase de valores positivos, cero y negativos puede escribirse como la diferencia de dos variables no-negativas.

Función objetivo:

Define la efectividad del modelo como función de las variables de decisión.

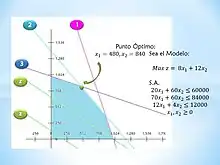

Solución óptima

Siempre está asociada a un punto extremo de la región factible y satisface todas las restricciones si se evalúa en ellas así como es el punto que en el caso de maximización hace que el valor de z sea el máximo (más grande) y el caso de minimización sea el mínimo (más pequeño).

Solución óptima múltiple

Existen problemas lineales que no tienen una solución óptima única, sino que al contrario, tienen un número infinito de soluciones.Para detectar una solución múltiple en la tabla óptima, se deberá tener al menos una variable con su Zj-Cj=0 no básica.

Algoritmo del método símplex

Este proceso que se repite una y otra vez, siempre inicia en un punto extremo de la región factible que normalmente es el origen, en cada repetición se mueve a otro punto extremo adyacente hasta llegar a la solución óptima.

Los pasos del método símplex son los siguientes:

- Utilizando la forma estándar, determinar una solución básica factible inicial igualando a las (n-m) variables a cero (el origen).

- Seleccionar la variable de entrada de las variables no básicas que al incrementar su valor pueda mejorar el valor en la función objetivo. Cuando no exista esta situación, la solución actual es la óptima; si no, ir al siguiente paso.

- Seleccionar la variable de salida de las variables básicas actuales.

- Determinar la nueva solución al hacer la variable de entrada básica y la variable de salida no básica, ir al paso 2 (actualizar).

Forma Matricial

Consideremos el modelo de programación lineal

puede ser representado mediante matrices de la siguiente forma

donde

Esto es , , , y .

Para obtener la forma aumentada del problema de programación lineal, introducimos el vector columna de las variables de holgura, esto es

de tal manera que las restricciones se convierten en

donde

es la matriz identidad de orden .

Obtención de la Solución Básica Factible

Debemos identificar las variables básicas y no básicas de

dado que se tienen que eliminar las variables no básicas al igualarlas a cero entonces queda un conjunto de ecuaciones con incógnitas (las variables básicas). Este sistema de ecuaciones lo denotamos por , donde el vector de variables básicas

se obtiene al eliminar las variables no básicas de

y la matriz base, denotada por

se obtiene al eliminar las columnas de

correspondientes a las variables no básicas, como la matriz base es invertible entonces la solución deseada para las variables básicas es .

Sea el vector renglón cuyos elementos son los coeficientes de la función objetivo (incluye los ceros para la variable de holgura) que corresponden a los elementos de . Así, el vector de la función objetivo de la solución básica es .

En el caso del conjunto de ecuaciones originales del modelo inicial aumentado, incluyendo la ecuación de la función objetivo, se puede representar como

dado que y entonces

Premultiplicando con la expresión hallada anteriormente obtenemos

Está forma matricial proporciona el conjunto de ecuaciones de cualquier iteración.

Prueba de Optimalidad

Se utilizan las expresiones Matricial es y para calcular los coeficientes de las variables no básicas de la función objetivo. La solución es óptima si y sólo si todos estos coeficientes son no negativos.

Enlaces externos

- Algoritmo Simplex Método Simplex paso a paso

- PHPSimplex Programa para resolver problemas con el Método Simplex desarrollado por alumnos de Ingeniería de Telecomunicaciones. Universidad de Málaga, UMA

- Ejercicios resueltos utilizando el Método Simplex Módulo de resolución para resolver modelos de Programación Lineal utilizando el Método Simplex

- Ejemplos clásicos resueltos por el Método Simplex.

Notas

- Cipra, Barry A (16 de mayo de 2000). «The Best of the 20th Century: Editors Name Top 10 Algorithms». SIAM News 33 (4). Archivado desde el original el 31 de enero de 2018. Consultado el 31 de enero de 2018.