Valor p

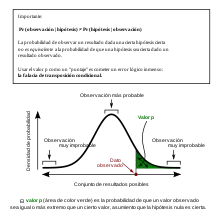

En estadística general y contrastes de hipótesis, el valor p (conocido también como p, p-valor, valor de p consignado, o directamente en inglés p-value) se define como la probabilidad de que un valor estadístico calculado sea posible dada una hipótesis nula cierta. En términos simples, el valor p ayuda a diferenciar resultados que son producto del azar del muestreo, de resultados que son estadísticamente significativos.

Otra definición aun más exacta para el valor p sería: La probabilidad de observar los resultados del estudio, u otros más alejados de la hipótesis nula, si la hipótesis nula fuera cierta.

Si el valor p cumple con la condición de ser menor que un nivel de significancia impuesto arbitrariamente, este se considera como un resultado estadísticamente significativo y, por lo tanto, permite rechazar la hipótesis nula.

Es fundamental reforzar que el valor p está basado en la presunción de que una hipótesis nula (o hipótesis de partida) es cierta. El valor p es por tanto una medida de significación estadística.

Interpretación

El valor p es un valor de probabilidad, por lo que oscila entre 0 y 1. El valor p nos muestra la probabilidad de haber obtenido el resultado que hemos obtenido suponiendo que la hipótesis nula H0 es cierta. Se suele decir que valores altos de p no permiten rechazar la H0, mientras que valores bajos de p sí permiten rechazar la H0.

En una prueba estadística, se rechaza la hipótesis nula H0 si el valor p asociado al resultado observado es igual o menor que un nivel de significación establecido arbitrariamente, convencionalmente 0,05 o 0,01. En otras palabras, si el resultado obtenido es más inusual que el rango esperado de resultados dada una hipótesis nula H0 cierta y el nivel de significación elegido, es decir si p es menor que , podemos decir que tenemos un resultado estadísticamente significativo que permite rechazar H0.

Es importante recalcar que un contraste de hipótesis no permite aceptar una hipótesis; simplemente la rechaza o no la rechaza, es decir que la tacha de verosímil (lo que no significa obligatoriamente que sea cierta, simplemente que es más probable de serlo) o inverosímil.

El valor p se utiliza en el contexto de la comprobación de hipótesis nulas para cuantificar la significación estadística de un resultado, siendo el resultado el valor observado de la estadística elegida .

La significación estadística de un resultado no implica que el resultado también tenga relevancia en el mundo real. Por ejemplo, un medicamento puede tener un efecto estadísticamente significativo que sea demasiado pequeño para ser interesante.

Cuanto menor sea el valor p, menor será la probabilidad de obtener ese resultado si la hipótesis nula fuera cierta. Se dice que un resultado es estadísticamente significativo si nos permite rechazar la hipótesis nula. En igualdad de condiciones, los valores p más pequeños se consideran pruebas más sólidas contra la hipótesis nula.

En términos generales, el rechazo de la hipótesis nula implica que hay suficientes pruebas en su contra.

Como ejemplo particular, si una hipótesis nula afirma que un determinado estadístico de resumen sigue la distribución normal estándar N(0,1), entonces el rechazo de esta hipótesis nula podría significar que (i) la media de no es 0, o (ii) la varianza de no es 1, o (iii) no se distribuye normalmente. Diferentes pruebas de la misma hipótesis nula serían más o menos sensibles a diferentes alternativas. Sin embargo, aunque consigamos rechazar la hipótesis nula para las 3 alternativas, y aunque sepamos que la distribución es normal y la varianza es 1, la prueba de la hipótesis nula no nos dice qué valores distintos de cero de la media son ahora más plausibles. Cuantas más observaciones independientes de la misma distribución de probabilidad se tengan, más exacta será la prueba y mayor la precisión con la que se podrá determinar el valor medio y demostrar que no es igual a cero; pero esto también aumentará la importancia de evaluar la relevancia en el mundo real o científico de esta desviación.

Advertencia sobre error por observación atípica

Aunque cuando el valor de p es inferior al nivel de significación , lo más verosímil es que la hipótesis de partida sea falsa, también es posible que estemos ante una observación atípica. Por eso, estaríamos cometiendo el error estadístico de rechazar la hipótesis nula cuando ésta es cierta, basándonos en que hemos tenido la mala suerte de encontrar una observación atípica. Este tipo de errores se puede subsanar siendo más estrictos y rebajando el máximo valor p esperado; un de 0,05 es usado en investigaciones habituales sociológicas mientras que un más bajo de 0,01 se utiliza en investigaciones médicas, en las que cometer un error puede acarrear consecuencias más graves. También se puede tratar de subsanar dicho error aumentando el tamaño de la muestra obtenida, lo que reduce la posibilidad de que el dato obtenido sea casualmente raro.

Definición

Probabilidad bajo la hipótesis nula de obtener un estadístico de prueba de valor real al menos tan extremo como el obtenido

Considere una prueba estadística observada de distribución desconocida . Entonces el valor p es la probabilidad a priori de observar un valor estadístico de prueba al menos tan "extremo" como si la hipótesis nula fuera cierta. Es decir:

- para una prueba de cola derecha unilateral,

- para una prueba de cola izquierda unilateral,

- para una prueba de dos caras. Si la distribución de es simétrica respecto a cero, entonces

Valor p como estadístico para realizar pruebas de significación

En una prueba de significación, la hipótesis nula se rechaza si el valor p es menor o igual que un valor umbral predefinido , que se denomina nivel alfa o nivel de significación. no se deriva de los datos, sino que lo establece el investigador antes de examinarlos. se establece comúnmente en 0,05, aunque a veces se utilizan niveles alfa más bajos. En 2018, un grupo de estadísticos liderado por Daniel Benjamin propuso la adaptación del valor 0,005 como valor estándar para la significación estadística en todo el mundo.[1]

El valor p es una función de la estadística de prueba elegida y, por tanto, es una variable aleatoria. Si la hipótesis nula fija la distribución de probabilidad de con precisión, y si esa distribución es continua, entonces cuando la hipótesis nula es verdadera, el valor p se distribuye uniformemente entre 0 y 1. Por lo tanto, el valor p no es fijo. Si se repite la misma prueba de forma independiente con datos nuevos, normalmente se obtendrá un valor p diferente en cada iteración. Si la hipótesis nula es compuesta, o la distribución de la estadística es discreta, la probabilidad de obtener un valor p menor o igual que cualquier número entre 0 y 1 es menor o igual que ese número, si la hipótesis nula es cierta. Sigue siendo cierto que los valores muy pequeños son relativamente improbables si la hipótesis nula es cierta, y que una prueba de significación al nivel se obtiene rechazando la hipótesis nula si el nivel de significación es menor o igual que .

Se pueden combinar diferentes valores p basados en conjuntos independientes de datos, por ejemplo utilizando la prueba de probabilidad combinada de Fisher.

Distribución

Cuando la hipótesis nula es verdadera, si toma la forma , y la variable aleatoria subyacente es continua, entonces la distribución de probabilidad del valor p es uniforme en el intervalo [0,1]. En cambio, si la hipótesis alternativa es verdadera, la distribución depende del tamaño de la muestra y del valor verdadero del parámetro estudiado.[2][3]

La distribución de los valores p para un grupo de estudios a veces se denomina curva p.[4] Una curva p puede utilizarse para evaluar la fiabilidad de la literatura científica, por ejemplo detectando sesgos de publicación o p-hacking.[4][5]

Ejemplos

Ejemplo con monedas

Se puede hacer un experimento estadístico para determinar si una moneda es justa (es decir, que la probabilidad de caer en cara o sello sea igual) o injusta (es decir, que la moneda esté arreglada para que uno de los dos resultados sea mucho más frecuente que el otro). Supongamos que lanzamos al aire una moneda 20 veces seguidas, y los resultados experimentales muestran que la moneda cae en cara 14 veces de las 20 lanzadas. ¿Es la moneda justa o injusta?

Para determinarlo, definimos como hipótesis nula «la moneda es justa», y como estadístico de prueba el «número de caras». La probabilidad de que una moneda justa caiga al menos 14 veces en cara si es lanzada 20 veces es el valor p de este experimento. Esta probabilidad puede ser calculada usando coeficientes binomiales, así:[6]

Esta probabilidad de 0.058 es el valor p, considerando solo resultados extremos que favorecen las caras, obtenido al aplicar una prueba unilateral. Sin embargo, en una moneda la desviación puede favorecer a caras o cruces. Por esto, usamos una prueba bilateral que simplemente considera la desviación posible en ambas direcciones. Como una moneda justa tiene una distribución binomial simétrica, el valor p bilateral es simplemente el doble del valor p unilateral. Es decir, 0.115.[7]

De esta forma, tenemos que

- Hipótesis nula (H0): la moneda es justa, con Prob(cara) = 0.5

- Estadística de prueba: número de caras

- Observación O: 14 caras en 20 lanzamientos;

- Nivel de significación elegido arbitrariamente: 0.05

- Un valor p bilateral para la observación O dado H0: 0.115

Así, el valor p calculado, 0.115, es mayor que el nivel de significación 0.05, que elegimos. Eso significa que el resultado de 14 caras en 20 lanzamientos no es inverosímil para una moneda justa, estando este resultado dentro del rango de resultados que se obtendría el 95% de las veces que se repita el experimento con una moneda justa. Por esta razón, no se rechaza la hipótesis nula; es decir, asumimos que la moneda es justa.

Nótese que, de obtenerse una sola cara más, es decir, 15 en 20 lanzamientos, el valor p resultante (bilateral) habría sido 0.0414 (4.14%); en este caso, la hipótesis nula tendría que ser rechazada para el nivel de significación elegido de 0.05; es decir, en tal caso asumiríamos que la moneda es injusta.

Ejemplo de situación cotidiana

Supongamos que dos amigos están en un bar y uno le dice a otro que es capaz de distinguir un whisky barato de uno caro. Como el otro amigo no lo cree, deciden hacer una prueba. El amigo bravucón dice que acierta qué tipo de whisky está tomando al menos el 90% de las veces, ya que a veces los hielos le distorsionan la cata. Deciden hacerle probar 20 whiskies (en noches distintas) y obtienen el resultado de que acertó sobre el contenido del vaso que estaba probando en 14 noches.

Dado que nuestro amigo dijo que acertaría el 90% de las veces y solo acertó el 70% de ellas (14 de 20 noches), ¿podemos creer a nuestro amigo o nos está engañando? ¿es posible que fallara por mala suerte, pero si le dejamos seguir intentándolo a la larga acertará el 90%? Está claro que si hubiera acertado todas las noches, o 19 de ellas, le creeríamos sin lugar a dudas; también si hubiera fallado todas, o casi todas, sabríamos que nos está engañando, pero con 14 sobre 20 es algo dudoso. Esto es lo que podemos medir con el valor de p.

Si suponemos que la hipótesis nula es cierta, es decir, que las catas de nuestro amigo se distribuyen según una binomial de parámetro 0,90, esto es, como una moneda que saliera cara el 90% de las veces y sello el 10%. ¿Cuál es la probabilidad de que una distribución binomial de parámetro 0,9 repetida 20 veces nos dé como resultado 14 caras y 6 sellos? Calculando esa probabilidad nos queda p = 0,008867 ≃ 0,89%. Si a este valor le sumamos la probabilidad de que acierte solo 13 veces, más la probabilidad de que acierte solo 12 veces y así hasta la probabilidad de que no acierte ninguna vez, es decir, la probabilidad de que acierte 14 o menos veces, esto nos da p = 0,011253 ≃ 1,13%. Este es el valor de p.

¿Qué significa esto? Pues significa que si realmente suponemos que nuestro amigo acierta el 90% de las veces que prueba una copa y ha probado 20 copas, la probabilidad de que acierte menos de 15 copas es del 1,13%. Por tanto, si elegimos un nivel de significación usual de 0,05, que significa que aceptamos equivocarnos el 5% de las veces si repitiéramos el experimento, como el valor de p es inferior al nivel de significación, rechazamos la hipótesis nula, y declaramos que nuestro amigo es un fanfarrón. Estadísticamente, esto lo hacemos porque el resultado observado (14 aciertos de 20 intentos) es muy poco probable si suponemos que acierta el 90% de las veces, por lo tanto asumimos que no era cierta la hipótesis nula.

¿Qué hubiera pasado si hubiera acertado las 20 veces? En ese caso el valor de p saldría muy alto, ya que es muy probable que una distribución binomial de parámetro 0,90 repetida 20 veces nos dé 20. Por tanto no rechazaríamos la hipótesis nula. Es decir, diríamos que es verosímil que acierte el 90% de las veces, es posible que lleve razón, no tenemos evidencias significativas en contra de ello ya que el valor de p nos ha resultado muy favorable.

El valor de p es la probabilidad de que de la población propuesta por la hipótesis nula se obtenga la muestra observada o una aún más alejada. El valor de p está relacionado con la probabilidad de error de tipo I.

Principios para el correcto uso e interpretación del valor de p

En 2016, la American Statistical Association publicó seis principios para el correcto uso e interpretación del valor de p. Muchos de estos principios abordan concepciones equivocadas y empleos erróneos. Los seis principios son los siguientes:[8][9][10]

- Los valores de p pueden indicar cómo son los datos de incompatibles con cierto modelo estadístico.

- Los valores de p no miden la probabilidad de que la hipótesis nula sea cierta, ni tampoco la probabilidad de que los datos hayan sido producidos enteramente al azar.[11]

- Conclusiones científicas y decisiones políticas o empresariales no deberían basarse únicamente en el hecho de que un valor de p supere un umbral especificado.

- Una inferencia apropiada implica un informe completo y transparencia.

- Ni el valor de p ni la significación estadística miden el tamaño de un efecto o la importancia de un resultado.

- En sí mismo, un valor de p no es una medida apropiada de la evidencia de un modelo o hipótesis.

Referencias

- Benjamin, Daniel J.; Berger, James O.; Johannesson, Magnus; Nosek, Brian A.; Wagenmakers, E.-J.; Berk, Richard; Bollen, Kenneth A.; Brembs, Björn; Brown, Lawrence; Camerer, Colin; Cesarini, David; Chambers, Christopher D.; Clyde, Merlise; Cook, Thomas D.; De Boeck, Paul; Dienes, Zoltan; Dreber, Anna; Easwaran, Kenny; Efferson, Charles; Fehr, Ernst; Fidler, Fiona; Field, Andy P.; Forster, Malcolm; George, Edward I.; Gonzalez, Richard; Goodman, Steven; Green, Edwin; Green, Donald P.; Greenwald, Anthony G.; Hadfield, Jarrod D.; Hedges, Larry V.; Held, Leonhard; Hua Ho, Teck; Hoijtink, Herbert; Hruschka, Daniel J.; Imai, Kosuke; Imbens, Guido; Ioannidis, John P. A.; Jeon, Minjeong; Jones, James Holland; Kirchler, Michael; Laibson, David; List, John; Little, Roderick; Lupia, Arthur; Machery, Edouard; Maxwell, Scott E.; McCarthy, Michael; Moore, Don A.; Morgan, Stephen L.; Munafó, Marcus; Nakagawa, Shinichi; Nyhan, Brendan; Parker, Timothy H.; Pericchi, Luis; Perugini, Marco; Rouder, Jeff; Rousseau, Judith; Savalei, Victoria; Schönbrodt, Felix D.; Sellke, Thomas; Sinclair, Betsy; Tingley, Dustin; Van Zandt, Trisha; Vazire, Simine; Watts, Duncan J.; Winship, Christopher; Wolpert, Robert L.; Xie, Yu; Young, Cristobal; Zinman, Jonathan; Johnson, Valen E. (1 de septiembre de 2017). «Redefine statistical significance». Nature Human Behaviour 2 (1): 6-10. doi:10.1038/s41562-017-0189-z.

- Bhattacharya B, Habtzghi D (2002). «Mediana del valor p bajo la hipótesis alternativa». The American Statistician 56 (3): 202-6. S2CID 33812107. doi:10.1198/000313002146.

- Hung HM, O'Neill RT, Bauer P, Köhne K (March 1997). «El comportamiento del valor P cuando la hipótesis alternativa es verdadera». Biometrics (Submitted manuscript) 53 (1): 11-22. JSTOR 2533093. PMID 9147587.

- Head ML, Holman L, Lanfear R, Kahn AT, Jennions MD (March 2015). «The extent and consequences of p-hacking in science». PLOS Biology 13 (3): e1002106. PMC 4359000. PMID 25768323.

- Simonsohn U, Nelson LD, Simmons JP (November 2014). «Curva p y tamaño del efecto: Correcting for Publication Bias Using Only Significant Results». Perspectives on Psychological Science 9 (6): 666-681. PMID 26186117. S2CID 39975518. doi:10.1177/1745691614553988.

- Este cálculo es válido para una prueba unilateral.

- Nótese que estamos duplicando el valor exacto 60460 / 1048576 = 0.057659+. Este valor, duplicado, es 0.115318+.

- Wasserstein RL, Lazar NA (2016). «The ASA's statement on p-values: context, process, and purpose». The American Statistician. doi:10.1080/00031305.2016.1154108.

- Sterne JAC, Smith GD (2001). «Sifting the evidence — what's wrong with significance tests?». BMJ 322 (7280): 226-231. PMID 11159626. doi:10.1136/bmj.322.7280.226.

- Schervish MJ (1996). «P Values: What They Are and What They Are Not». The American Statistician 50 (3): 203-206. doi:10.2307/2684655.

- Lo cuál es diferente al azar del muestreo.

Bibliografía adicional

- Denworth L (October 2019). «A Significant Problem: Standard scientific methods are under fire. Will anything change?». Scientific American 321 (4): 62-67 (63). «The use of p values for nearly a century [since 1925] to determine statistical significance of experimental results has contributed to an illusion of certainty and [to] reproducibility crises in many scientific fields. There is growing determination to reform statistical analysis... Some [researchers] suggest changing statistical methods, whereas others would do away with a threshold for defining "significant" results. »

- Elderton WP (1902). «Tables for Testing the Goodness of Fit of Theory to Observation». Biometrika 1 (2): 155-163. doi:10.1093/biomet/1.2.155.

- Fisher RA (1925). Statistical Methods for Research Workers. Edinburgh, Scotland: Oliver & Boyd. ISBN 978-0-05-002170-5.

- Fisher RA (1971). The Design of Experiments (9th edición). Macmillan. ISBN 978-0-02-844690-5.

- Fisher RA, Yates F (1938). Statistical tables for biological, agricultural and medical research. London, England.

- Stigler SM (1986). The history of statistics : the measurement of uncertainty before 1900. Cambridge, Mass: Belknap Press of Harvard University Press. ISBN 978-0-674-40340-6. (requiere registro).

- Hubbard R, Armstrong JS (2006). «Why We Don't Really Know What Statistical Significance Means: Implications for Educators». Journal of Marketing Education 28 (2): 114-120. S2CID 34729227. doi:10.1177/0273475306288399. hdl:2092/413. Archivado desde el original el 18 de mayo de 2006.

- Hubbard R, Lindsay RM (2008). «Why P Values Are Not a Useful Measure of Evidence in Statistical Significance Testing». Theory & Psychology 18 (1): 69-88. S2CID 143487211. doi:10.1177/0959354307086923. Archivado desde el original el 21 de octubre de 2016. Consultado el 28 de agosto de 2015.

- Stigler S (December 2008). «Fisher and the 5% level». Chance 21 (4): 12. doi:10.1007/s00144-008-0033-3.

- Dallal GE (2012). The Little Handbook of Statistical Practice.

- Biau DJ, Jolles BM, Porcher R (March 2010). «P value and the theory of hypothesis testing: an explanation for new researchers». Clinical Orthopaedics and Related Research 468 (3): 885-892. PMC 2816758. PMID 19921345. doi:10.1007/s11999-009-1164-4.

- Reinhart A (2015). Statistics Done Wrong: The Woefully Complete Guide. No Starch Press. p. 176. ISBN 978-1593276201.