Tensor

En matemáticas, un tensor es un objeto algebraico que describe una relación multilineal entre conjuntos de objetos algebraicos relacionados con un espacio vectorial. Entre los objetos que los tensores pueden mapear se incluyen vectores y escalares, e incluso otros tensores. Hay muchos tipos de tensores, incluidos escalares y vectores (que son los tensores más simples), vectores duales, mapas multilineales entre espacios vectoriales e incluso algunas operaciones como el producto escalar. Los tensores se definen independientemente de cualquier base, aunque a menudo se hace referencia a ellos por sus componentes en una base relacionada con un sistema de coordenadas particular.

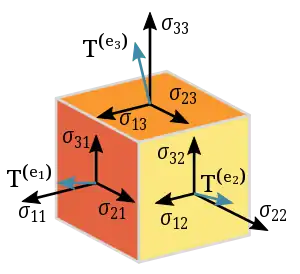

Los tensores se han vuelto importantes en física porque proporcionan un marco matemático conciso para formular y resolver problemas de física en áreas como la mecánica (tensión, elasticidad, mecánica de fluidos, momento de inercia entre otros), electrodinámica (tensor electromagnético, tensor de Maxwell, permitividad, susceptibilidad magnética), o relatividad general (tensor tensión-energía, tensor de curvatura, ...) y otros. En las aplicaciones, es común estudiar situaciones en las que puede ocurrir un tensor diferente en cada punto de un objeto; por ejemplo, la tensión dentro de un objeto puede variar de un lugar a otro. Esto conduce al concepto de campo tensorial. En algunas áreas, los campos tensoriales son tan omnipresentes que a menudo se les llama simplemente "tensores".

Tullio Levi-Civita y Gregorio Ricci-Curbastro popularizaron los tensores en 1900, continuando el trabajo anterior de Bernhard Riemann y Elwin Bruno Christoffel y otros, como parte del cálculo diferencial absoluto. El concepto permitió una formulación alternativa de la geometría diferencial intrínseca de una variedad en la forma del tensor de curvatura de Riemann.[1]

Definición

Aunque aparentemente diferentes, los diversos enfoques para definir tensores describen el mismo concepto geométrico utilizando un lenguaje diferente y en diferentes niveles de abstracción. Por ejemplo, los tensores se definen y analizan para aplicaciones estadísticas y de aprendizaje automático.[2] De ese modo el tensor recibe dimensionalidad. Un tensor de primer rango es de magnitud escalar, por ejemplo, mientras que un tensor de segundo rango se vuelve un vector con una matriz de dos dimensiones. Un n-contra-tensor no es más que un tipo particular de tensor: un tensor contravariante de valencia . Para n = 1 tenemos un tensor elemental: un vector columna.

Como matrices multidimensionales

Un tensor puede representarse como una matriz (potencialmente multidimensional). Así como un vector en un espacio n-dimensional está representado por una matriz unidimensional con n componentes con respecto a una determinada base, cualquier tensor con respecto a una base está representado por una matriz multidimensional. Por ejemplo, un operador lineal se representa sobre una base como una matriz bidimensional cuadrada n × n. Los números en la matriz multidimensional se conocen como los componentes escalares del tensor o simplemente sus componentes. Se indican mediante índices que dan su posición en la matriz, como subíndices y superíndices, siguiendo el nombre simbólico del tensor. Por ejemplo, los componentes de un tensor T de orden 2 podría ser denotado Tij , donde i y j son índices que van de 1 a n , o también por T i

j. El hecho de que un índice se muestre como superíndice o subíndice depende de las propiedades de transformación del tensor, que se describen a continuación. Así, mientras que Tij y T i

j ambos pueden expresarse por matrices de n x n, y están relacionados numéricamente a través de sus índices, la diferencia en sus leyes de transformación indica que sería incorrecto sumarlos. El número total de índices necesarios para identificar cada componente de forma única es igual a la dimensión de la matriz y se denomina orden, grado o rango del tensor. Sin embargo, el término "rango" generalmente tiene otro significado en el contexto de matrices y tensores.

Así como las componentes de un vector cambian cuando cambiamos la base del espacio vectorial, las componentes de un tensor también cambian bajo tal transformación. Cada tipo de tensor viene equipado con una ley de transformación que detalla cómo los componentes del tensor responden a un cambio de base. Los componentes de un vector pueden responder de dos formas distintas a un cambio de base (ver covarianza y contravarianza de vectores ), donde los nuevos vectores base } se expresan en términos de los vectores base antiguos como,

Aquí R ji son las entradas de la matriz de cambio de base, y en la expresión más a la derecha se suprimió el signo de suma: este es el Convenio de suma de Einstein, el cual se utilizará a lo largo de este artículo.[3] Los componentes vi de un vector columna v se transforman con la inversa de la matriz R,

donde el sombrero denota los componentes de la nueva base. Esto se llama ley de transformación contravariante, porque los componentes del vector se transforman por el inverso del cambio de base. En contraste, los componentes, wi, de un covector (o vector fila), w se transforman con la matriz R misma,

Esto se denomina ley de transformación covariante, porque los componentes del covector se transforman mediante la misma matriz que la matriz de cambio de base. Los componentes de un tensor más general se transforman mediante alguna combinación de transformaciones covariantes y contravariantes, con una ley de transformación para cada índice. Si la matriz de transformación de un índice es la matriz inversa de la transformación base, entonces el índice se llama contravariante y se denota convencionalmente con un índice superior (superíndice). Si la matriz de transformación de un índice es la transformación de base en sí, entonces el índice se llama covariante y se denota con un índice más bajo (subíndice).

Como ejemplo simple, la matriz de un operador lineal con respecto a una base es un arreglo rectangular que se transforma bajo una matriz de cambio de base por . Para las entradas individuales de la matriz, esta ley de transformación tiene la forma Error al representar (SVG (MathML puede ser habilitado mediante un plugin de navegador): respuesta no válida («Math extension cannot connect to Restbase.») del servidor «http://localhost:6011/es.wikipedia.org/v1/»:): {\displaystyle \hat{T}^{i'}_{j'} = \left(R^{-1}\right)^{i'}_i T^i_j R^j_{j'}} por lo que el tensor correspondiente a la matriz de un operador lineal tiene un índice covariante y uno contravariante: es de tipo (1,1).

Las combinaciones de componentes covariantes y contravariantes con el mismo índice nos permiten expresar invariantes geométricas. Por ejemplo, el hecho de que un vector sea el mismo objeto en diferentes sistemas de coordenadas puede ser capturado por las siguientes ecuaciones, usando las fórmulas definidas anteriormente:

- ,

donde es la delta de Kronecker, que funciona de manera similar a la matriz identidad, y tiene el efecto de renombrar a los ídices (j en k en este ejemplo).Esto muestra varias características de la notación de componentes: la capacidad de reorganizar los términos a voluntad (conmutatividad), la necesidad de usar diferentes índices cuando se trabaja con varios objetos en la misma expresión, la capacidad de cambiar el nombre de los índices y la forma en que la contravariante y los tensores covariantes se combinan para que todas las instancias de la matriz de transformación y su inversa se cancelen, de modo que expresiones como inmediatamente se puede ver que es geométricamente idéntica en todos los sistemas de coordenadas..

De manera similar, un operador lineal, visto como un objeto geométrico, en realidad no depende de una base: es solo un mapa lineal que acepta un vector como argumento y produce otro vector. La ley de transformación de cómo la matriz de componentes de un operador lineal cambia con la base es consistente con la ley de transformación para un vector contravariante, de modo que la acción de un operador lineal sobre un vector contravariante se representa en coordenadas como el producto matricial de su respectivas representaciones de coordenadas. Es decir, los componentes son dadas por . Estos componentes se transforman de forma contravariante, ya que

La ley de transformación para un tensor de orden p + q con p índices contravariantes y q índices covariantes queda expresada como,

Aquí, los índices con comilla denotan componentes en las nuevas coordenadas, y los índices sin comilla denotan las componentes en las coordenadas antiguas. Se dice que tal tensor es de orden o tipo (p, q) . Los términos "orden", "tipo", "rango", "valencia" y "grado" se utilizan a veces para el mismo concepto. Aquí, el término "orden" u "orden total" se utilizará para la dimensión total de la matriz (o su generalización en otras definiciones), p + q en el ejemplo anterior, y el término "tipo" para el par que da el número de índices contravariantes y covariantes. Un tensor de tipo (p, q) también es denominado un tensor (p, q) en forma abreviada.

Como mapas multilineales

Una desventaja de la definición de un tensor utilizando el enfoque de matriz multidimensional es que no es evidente a partir de la definición que el objeto definido sea de hecho independiente de la base, como se espera de un objeto intrínsecamente geométrico. Aunque es posible demostrar que las leyes de transformación de hecho garantizan la independencia de la base, a veces se prefiere una definición más intrínseca. Un enfoque que es común en la geometría diferencial es definir tensores en relación con un espacio vectorial fijo (de dimensión finita) V , que generalmente se considera un espacio vectorial particular de algún significado geométrico como el espacio tangente a una variedad.[4] En este enfoque, un tipo de tensor T (p, q) se define como un mapa multilineal,

donde V∗ es el correspondiente espacio dual de covectores, que es lineal en cada uno de sus argumentos. Lo anterior supone que V es un espacio vectorial sobre los números reales, ℝ. De manera más general, V se puede tomar sobre cualquier campo F (por ejemplo los números complejos), con F reemplazando a ℝ como el codominio de los mapas multilineales.

Aplicando un mapa multilineal T del tipo (p, q) a una base {ej} paraV y una cobasis canónica {εi} para V∗,

se obtiene un arreglo (p + q)-dimensional de componentes. Una elección diferente de base producirá componentes diferentes. Pero, debido a que T es lineal en todos sus argumentos, los componentes satisfacen la ley de transformación del tensor utilizada en la definición de matriz multilineal. La matriz multidimensional de componentes de T por lo tanto forma un tensor de acuerdo con esa definición. Además, tal matriz se puede realizar como los componentes de algún mapa T multilineal. Esto motiva a ver los mapas multilineales como los objetos intrínsecos subyacentes a los tensores.

En la visualización de un tensor como un mapa multilineal, es convencional para identificar la doble dual V ** del espacio vectorial V , es decir, el espacio de funcionales lineales en el espacio dual vector V * , con el espacio vectorial V . Siempre hay un mapa lineal naturales de V a su doble dual, dado mediante la evaluación de una forma lineal en V * en contra de un vector en V . Este mapeo lineal es un isomorfismo en dimensiones finitas y, a menudo, es conveniente identificar V con su doble dual.

Usando productos tensoriales

Para algunas aplicaciones matemáticas, a veces es útil un enfoque más abstracto. Esto se puede lograr definiendo tensores en términos de elementos de productos tensoriales de espacios vectoriales, que a su vez se definen mediante una propiedad universal. Un tensor de tipo ( p , q ) se define en este contexto como un elemento del producto tensorial de espacios vectoriales,[5][6]

Una base vi de V y la base wj de W naturalmente induce una base vi ⊗ wj del producto de tensores V ⊗ W. Los componentes de un tensor T son los coeficientes del tensor con respecto a la base obtenida de una base {ei} para V y su base dual {ε j}, o sea.

Usando las propiedades del producto tensorial, se puede demostrar que estos componentes satisfacen la ley de transformación para un tensor de tipo (p, q). Por otra parte, la propiedad universal del producto tensorial da una correspondencia 1-a-1 entre tensores definidos de esta manera y tensores definidos como funciones multilineales.

Esta correspondencia 1 a 1 se puede archivar de la siguiente manera, porque en el caso de dimensión finita existe un isomorfismo canónico entre un espacio vectorial y su doble dual:

La última línea usa la propiedad universal del producto tensorial, que existe una correspondencia de 1 a 1 entre los mapas de and .[7]

Los productos tensoriales se pueden definir con gran generalidad, por ejemplo, que involucran módulos arbitrarios sobre un anillo. En principio, se podría definir un "tensor" simplemente como un elemento de cualquier producto tensorial. Sin embargo, la literatura matemática generalmente reserva el término tensor para un elemento de un producto tensorial de cualquier número de copias de un solo espacio vectorial V y su dual, como se indicó anteriormente.

Tensores en infinitas dimensiones

Esta discusión de los tensores hasta ahora asume una dimensionalidad finita de los espacios involucrados, donde los espacios de los tensores obtenidos por cada una de estas construcciones son naturalmente isomórficos.[8] Las construcciones de espacios de tensores basadas en el producto tensorial y los mapeos multilineales se pueden generalizar, esencialmente sin modificación, a haces de vectores o poleas coherentes.[9] Para espacios vectoriales de dimensión infinita, las topologías inequivalentes conducen a nociones inequivalentes de tensor, y estos diversos isomorfismos pueden o no ser válidos dependiendo de lo que se signifique exactamente por un tensor (ver producto de tensor topológico). En algunas aplicaciones, es el producto tensorial de los espacios de Hilbert.es decir, cuyas propiedades son las más similares al caso de dimensión finita. Una visión más moderna es que es la estructura de los tensores como una categoría monoidal simétrica la que codifica sus propiedades más importantes, en lugar de los modelos específicos de esas categorías.[10]

Campos tensor

En muchas aplicaciones, especialmente en geometría diferencial y física, es natural considerar un tensor con componentes que son funciones del punto en un espacio. Este fue el escenario de la obra original de Ricci. En la terminología matemática moderna, tal objeto se denomina campo tensor, a menudo denominado simplemente tensor.[1]

En este contexto, a menudo se elige una base de coordenadas para el espacio vectorial tangente. La ley de transformación puede entonces expresarse en términos de derivadas parciales de las funciones de coordenadas,

definir una transformación de coordenadas,[1]

Aplicaciones

Una aplicación de los tensores es la biblioteca TensorFlow desarrollada por Google en 2015. Esta biblioteca está diseñada para construir y entrenar redes neuronales donde los nodos son ecuaciones matemáticas y las aristas son tensores. Entonces, en estas redes neuronales se realizan operaciones matemáticas sobre tensores o arreglos multidimensionales.

El uso de TensorFlow está principalmente dirigido a las redes neuronales de tipo Deep Learning donde se tienen múltiples capas escondidas de operaciones intermedias antes de entregar una salida, para lo cual Google sigue siendo una de las principales empresas que hacen uso de la tecnología. También es de notar que TensorFlow es más eficiente en máquinas de tipo cluster, donde un nodo maestro reparte el cálculo correspondiente al TensorFlow entre varias máquinas, de tal forma que el cálculo sea más eficiente y rápido; esto es conocido como TensorFlow distribuido.

Referencias

- Kline, Morris (March 1990). Mathematical Thought From Ancient to Modern Times: Volume 3. Oxford University Press, USA. ISBN 978-0-19-506137-6.

- Bi, Xuan; Tang, Xiwei; Yuan, Yubai; Zhang, Yanqing; Qu, Annie (2021). «Tensors in Statistics.». Annual Review of Statistics and Its Application 8 (1): annurev. Bibcode:2021AnRSA...842720B. doi:10.1146/annurev-statistics-042720-020816.

- The Einstein summation convention, in brief, requires the sum to be taken over all values of the index whenever the same symbol appears as a subscript and superscript in the same term. For example, under this convention

- Lee, John (2000), Introduction to smooth manifolds, Springer, p. 173, ISBN 978-0-387-95495-0.

- Dodson, CTJ; Poston, T (1991), Tensor geometry, Graduate Texts in Mathematics 130, Springer, p. 105.

- Hazewinkel, Michiel, ed. (2001), «Affine tensor», Encyclopaedia of Mathematics (en inglés), Springer, ISBN 978-1556080104.

- https://math.stackexchange.com/users/568204/peek-a-boo (5 de junio de 2021). «Why are Tensors (Vectors of the form a⊗b...⊗z) multilinear maps?». Mathematics Stackexchange.

- The double duality isomorphism, for instance, is used to identify V with the double dual space V∗∗, which consists of multilinear forms of degree one on V∗. It is typical in linear algebra to identify spaces that are naturally isomorphic, treating them as the same space.

- Bourbaki, N. (3 de agosto de 1998). «3». Algebra I: Chapters 1-3. Springer Science & Business Media. ISBN 978-3-540-64243-5. where the case of finitely generated projective modules is treated. The global sections of sections of a vector bundle over a compact space form a projective module over the ring of smooth functions. All statements for coherent sheaves are true locally.

- Joyal, André; Street, Ross (1993), «Braided tensor categories», Advances in Mathematics 102: 20-78.

Enlaces externos

Wikimedia Commons alberga una categoría multimedia sobre Tensor.

Wikimedia Commons alberga una categoría multimedia sobre Tensor.- Weisstein, Eric W. «Tensor». En Weisstein, Eric W, ed. MathWorld (en inglés). Wolfram Research.

- Ray M. Bowen and C. C. Wang (1976). Introduction to Vectors and Tensors, Vol 1: Linear and Multilinear Algebra. New York, NY.: Plenum Press.

- Ray M. Bowen and C. C. Wang (2006). Introduction to Vectors and Tensors, Vol 2: Vector and Tensor Analysis.

- An Introduction to Tensors for Students of Physics and Engineering by Joseph C. Kolecki, Glenn Research Center, Cleveland, Ohio, released by NASA

- Foundations of Tensor Analysis for Students of Physics and Engineering With an Introduction to the Theory of Relativity by Joseph C. Kolecki, Glenn Research Center, Cleveland, Ohio, released by NASA

- A discussion of the various approaches to teaching tensors, and recommendations of textbooks

- Sharipov, Ruslan (2004). «Quick introduction to tensor analysis». .

- Richard Feynman's lecture on tensors.

- Vázquez Torres, Gabriel (14 de noviembre de 2017). «Qué es Deep Learning». Consultado el 11 de septiembre de 2021.

- Mayo, Matthew (2018). «WTF is a Tensor?!?» (en inglés). Consultado el 10 de septiembre de 2021.

- Silvester, Minat (28 de marzo de 2020). «What are tensors? How are they used in Machine Learning.» (en inglés). Consultado el 18 de septiembre de 2021.